Para estar a par do Big Brother Brasil, você não precisa assistir ao programa. Você não precisa pagar o pay-per-view, nem mesmo acessar o GShow. Além das redes mainstream, como Twitter e Instagram, onde usuários se engajam em debates, comentários e publicações sobre o programa, há também canais do Telegram dedicados à casa mais vigiada do Brasil.

Tamanha é a popularidade desses canais do aplicativo de mensagens que eles viraram referência nas conversas e notícias sobre o reality show, inclusive pautando outras redes.

Essa cobertura começou a mudar no fim de fevereiro, quando o Telegram começou a ir atrás desses canais, cada um com centenas de milhares de inscritos, por violações de direitos autorais. Todo conteúdo do BBB pertence à TV Globo, uma força implacável quando o assunto é proteger seu conteúdo.

- O Canal BBB21 caiu primeiro, dia 23 de fevereiro;

- O Espiadinha, que já havia sido notificado três vezes, caiu em 6 de março, o que levou o termo "Telegram" ao topo dos trending topics do Twitter Brasil. Voltou logo depois, com cerca de 140 mil inscritos;

- O Alienadinhos (ex-Canal BBB21) caiu em 17 de março e já voltou em outro canal (aparentemente um reserva criado em 17 de fevereiro), com mais de 60 mil inscritos.

É importante porque...

- Briga contra desinformação ainda precisa de definições precisas

- Tema conversa com debate sobre liberdade de expressão

O episódio mostrou como as plataformas podem atuar incisivamente em casos de violação de direitos autorais. Por que essas empresas agem sistematicamente contra quebra de copyright, mas não adotam o mesmo rigor, por exemplo, contra desinformação?

Embora seja tentador dizer que isso reflete apenas um "corpo mole" das plataformas de não intervir em práticas de desinformação, a discussão é bem mais complexa.

Alguns pontos principais da apuração do Núcleo:

- Há uma noção mais aceita sobre o que configura violações a direitos autorais do que sobre o que configura desinformação;

- As Big Tech, em geral, possuem alguns esforços contra desinformação, que em geral não contemplam sistematicamente a remoção de conteúdo, e sim medidas como rotulagem de posts ou com penalidade no algoritmo de divulgação;

- Determinar se um conteúdo viola ou não direitos autorais ainda é uma questão delicada;

- Desinformação por vezes se mistura com liberdade de expressão, o que torna difícil coibir certos tipos de conteúdo.

DADOS DE REMOÇÕES

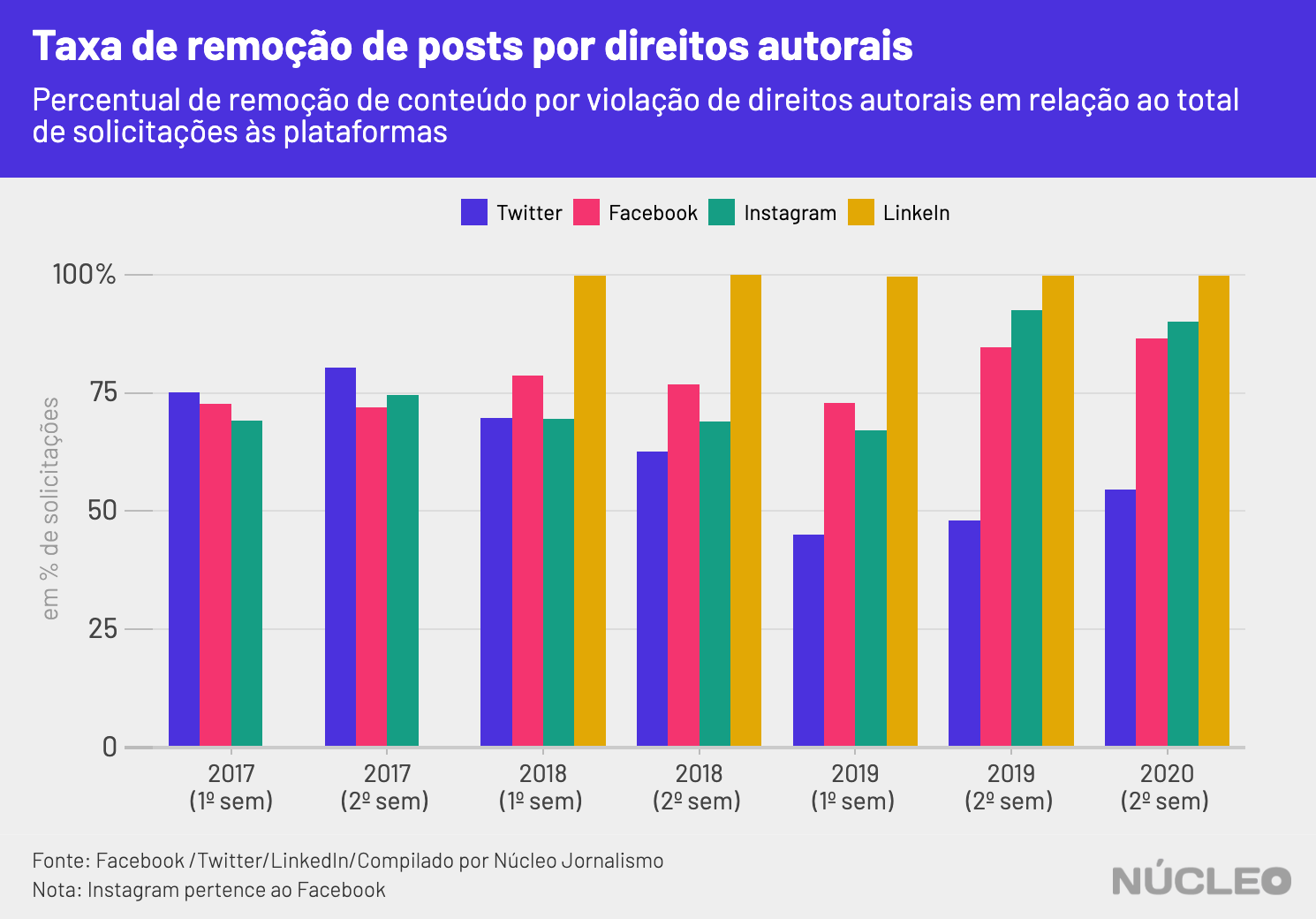

No primeiro semestre de 2020, o Twitter teve uma taxa de remoção de conteúdos de 54% em relação ao total de denúncias de violação de direitos autorais, ao passo que no Facebook essa taxa foi de 81% no mesmo período. No Instagram e na rede de vídeos TikTok, a taxa foi de quase 90%.

A rede de contatos profissionais LinkedIn, a única que discrimina remoção de desinformação (a partir de janeiro de 2020), removeu mais de 125 mil conteúdos (99,99% das solicitações) com violações de direitos autorais. Posts derrubados por desinformação foram 22,8 mil.

IMUNIDADE

Atualmente, no Brasil, a chamada imunidade das plataformas

A imunidade das plataformas prevê que as empresas de redes sociais possam atuar na retirada de conteúdo ou suspensão de contas sem que sejam responsabilizadas judicialmente por essa ação se, no caso de um processo judicial, um tribunal vir a divergir no entendimento sobre a necessidade de remoção ou bloqueio daquele conteúdo. No Brasil, essa proteção é assegurada pelo Marco Civil da Internet.

isenta as empresas de redes sociais de serem responsabilizadas por conteúdos de terceiros, mas estabelece que uma lei irá determinar o que ocorrerá no caso de direitos autorais.

O problema é que essa legislação nunca veio, explicou ao Núcleo a advogada Mariana Valente, especialista em direitos autorais, professora do Insper e diretora do InternetLab Brasil.

"Para direito autoral o que está valendo é um entendimento da jurisprudência de que, uma vez que as plataformas são notificadas, elas já se tornam responsáveis se aquele conteúdo for considerado ilícito depois no Judiciário", disse ela. Nos EUA, essa questão foi contemplada em 1998, com o Ato de Direitos Autorais do Milênio Digital, de 1998, que é aderido hoje pelas maiores empresas de Big Tech.

Como, no passado, processos de direitos autorais já geraram litígios com custos altos para algumas plataformas, redes como o YouTube já automatizam processos. No caso do YouTube, é o ContentID, que reconhece obras protegidas. Em relatório publicado em 2018, o Google, que detém o Youtube, disse que 98% das ações de copyright no ano de 2017 foram automatizadas, isto é, o próprio ContentID já identificou o conteúdo e aplicou medidas que o proprietário optou previamente, sem que fosse necessária uma intervenção do proprietário naquele caso.

"Quem pede remoção dos conteúdos protegidos por direitos autorais tem poder econômico, e isso foi gerando ao longo do tempo algumas alianças das plataformas com essas empresas para gerar uma remoção de conteúdo mais fácil", disse Mariana.

LIBERDADE DE EXPRESSÃO OU FAKE NEWS?

Já há casos, no Brasil, de bloqueio de canais no YouTube por disseminação de desinformação, como aconteceu com o youtuber bolsonarista Allan dos Santos, do canal Terça Livre. No início de fevereiro, o Google removeu de sua plataforma dois canais que pertenciam ao blogueiro, alegando disseminação recorrente de desinformação, além de financiamento de ações antidemocráticas.

Poucos dias depois, em 12 de fevereiro, o Tribunal de Justiça de São Paulo (TJSP) determinou que o Google reativasse os canais de Allan dos Santos no YouTube. No despacho, o juiz relator avaliou que a remoção das contas se mostrou "desproporcional, violando a garantia constitucional da liberdade de expressão e de informação".

Mas a moderação por parte das big techs, seja na suspensão de perfis ou remoção de conteúdos, não significa necessariamente uma violação à liberdade de expressão. Há um entendimento de parte do direito constitucional de que a liberdade de expressão não é absoluta.

"Há um cerceamento constitucional à liberdade de expressão que existe tradicionalmente no nosso sistema jurídico, e nem por isso a nossa liberdade de expressão deixa de existir", disse ao Núcleo o advogado João Vitor Archegas, pesquisador da área de Direito e Tecnologia do ITS.

O mesmo vale para as redes sociais, onde certos conteúdos não podem ser veiculados ou disseminados pois atentam contra as estruturas democráticas, por exemplo. "Moderar conteúdo de acordo com esses princípios e preceitos não significa que a liberdade de expressão deixa de existir e deixa de ser protegida, ela só é limitada para garantir outros valores de igual importância", disse Archegas.

No caso de desinformação, diferentemente de conteúdos que atentem contra a democracia, a linha é mais tênue. Mas as plataformas poderiam agir de maneira mais proativa, estabelecendo uma espécie de auto-regulação, uma vez que estão protegidas pela imunidade das plataformas.

Para isso seria preciso rever a imunidade das plataformas, como defendeu Virgílio Almeida, professor associado do Berkman Klein Center para Internet e Sociedade na Universidade Harvard. "Já que empresas de tecnologia são as beneficiárias mais diretas da Seção 230 [legislação americana que as isenta de responsabilidade por conteúdo de terceiros], seria interessante considerar que elas têm a responsabilidade de mostrar que essa imunidade extraordinária é usada em benefício da sociedade”, disse Almeida em entrevista concedida à Folha de S.Paulo em novembro.

Outros países, como o Reino Unido, já caminham nessa direção. Com a chamada lei das fake news o Brasil se afastou desse possível regime e optou por punir as plataformas, em lugar de estabelecer uma colaboração, avaliou Archegas.

COMO FIZEMOS ISSO

O Núcleo entrou em contato com o Telegram em busca do número de remoções de conteúdos por violações de direitos autorais, mas não obteve resposta. Também enviamos perguntas para os dois canais do BBB no Telegram, que não nos retornaram até o momento.

A seguir, a lista com dados sobre remoções de conteúdo de grandes plataformas:

O Google tem um volume de dados muito maior sobre remoção de conteúdo, e seus dados não estão consolidados para comparação como nas plataformas mencionadas acima.