Um dos serviços pioneiros de mensagens instantâneas, o ICQ é associado por muitos usuários mais antigos a uma época menos conturbada de redes sociais. Esses dias de nostalgia podem estar no fim.

Investigação do Núcleo mostra que o ICQ se tornou um veículo para venda de pornografia infantil, com alcance alavancado por links compartilhados em grupos abertos no Facebook e indexados por mecanismos de busca.

O Núcleo identificou e acompanhou um total de 13 grupos de pornografia infantil hospedados no ICQ durante duas semanas em jun.2023. O conteúdo desses grupos foi amplificado com a divulgação de links feitas via plataformas maiores – também sem moderação específica. Entre esses grupos, o acesso a 3 deles foi descoberto via grupos no Facebook.

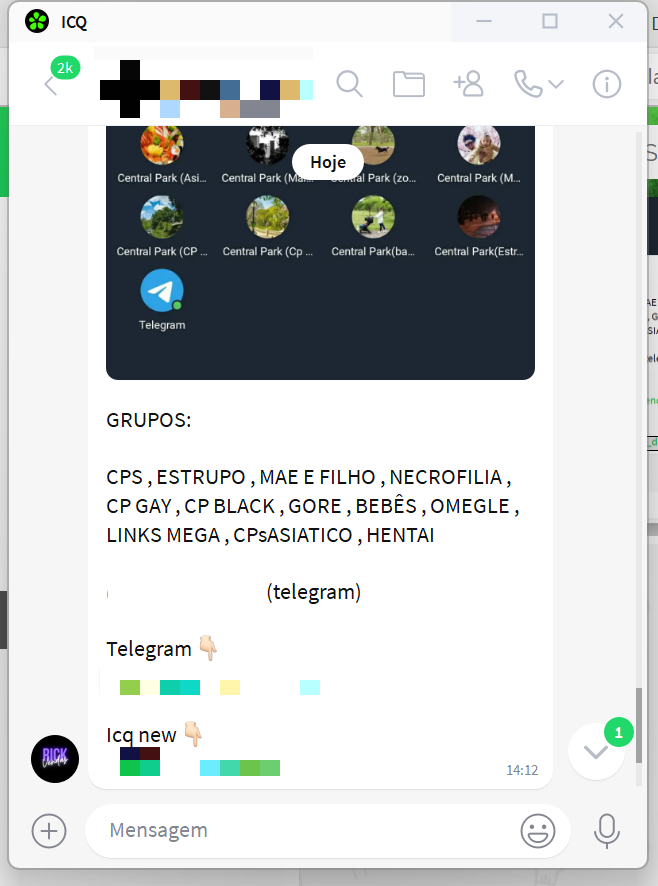

Todos estão envolvidos explicitamente no compartilhamento e na venda de conteúdo de pornografia infantil – que inclui imagens de abuso sexual, exploração sexual e prostituição envolvendo menores de idade.

É ✷ importante ✷ porque...

A disseminação de pornografia infantil expõe as vítimas a um ciclo de vulnerabilidade constante, aumentando o risco de abusos futuros e expondo suas imagens permanentemente

A falta de moderação efetiva nas plataformas digitais amplia o alcance desses grupos de exploração sexual infantil

A ausência de um escritório ou representante do ICQ no Brasil dificulta a denúncia desse conteúdo e a ação necessária por parte das grandes empresas para resolver o problema

No ano passado, o Núcleo trouxe à tona denúncias de grupos – alguns com dezenas de milhares de usuários – de exploração sexual infantil. Por conta da reportagem, o Facebook derrubou os sete grupos investigados pelo Núcleo.\

Recentemente, pesquisadores de Stanford revelaram que os algoritmos do Instagram chegaram a promover conteúdo ilícito de pedofilia.

Páginas com esse tipo de conteúdo continuam a exibir imagens de crianças e adolescentes em poses sugestivas ou seminuas, visando à erotização, especialmente de meninas.

Algumas dessas imagens retratam menores usando uniformes escolares, o que deveria facilitar sua identificação e remoção por meio da moderação humana do Facebook.

As políticas de conteúdo da Meta, proprietária do Facebook, proíbem o compartilhamento ou a produção de “conteúdo (incluindo fotos, vídeos, obras de arte reais, conteúdo digital e representações verbais) que sexualize crianças, bem como grupos, páginas e perfis dedicados à sexualização de crianças”.

A legislação brasileira também trata do assunto.

Buscas no Facebook

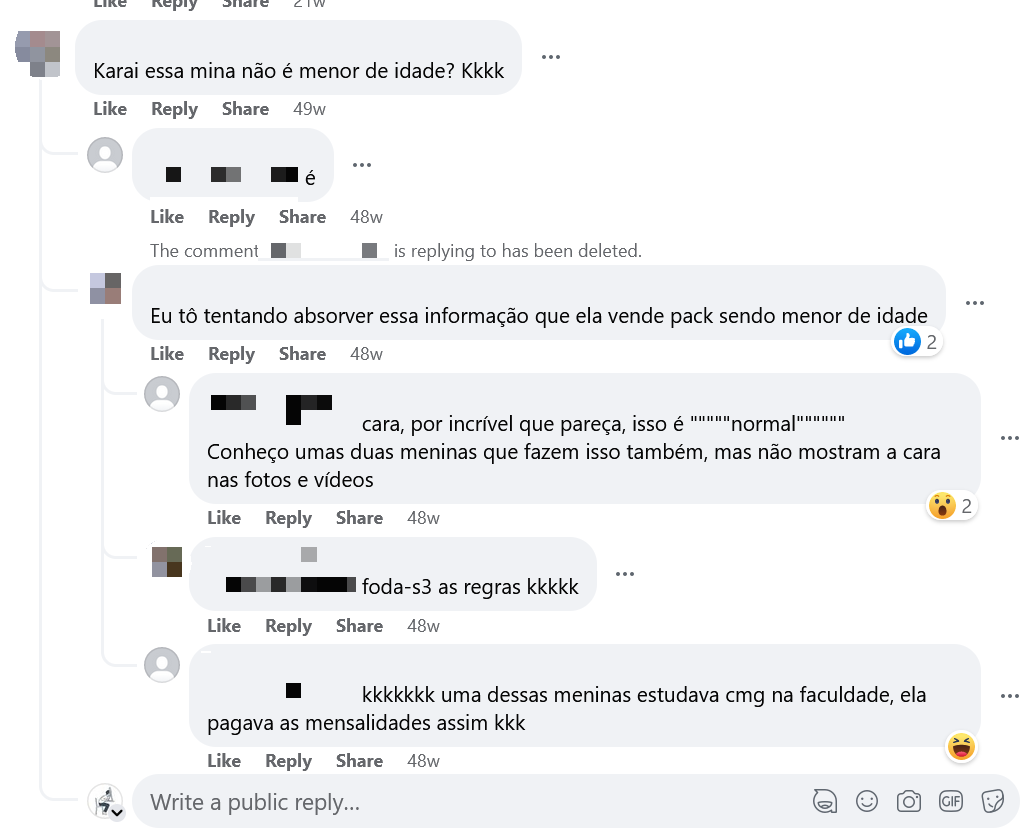

Em uma das páginas com conteúdo de exploração sexual infantil no Facebook, um usuário questionou se uma determinada pessoa era menor de idade, ao que outro usuário respondeu que é comum menores de idade venderem fotos seminuas ou sexualizadas, e o primeiro usuário respondeu: "Foda-se as regras kkkkk".

Durante os testes realizados pela equipe do Núcleo, ao pesquisar pela sigla relativa ao termo em inglês de "pornografia infantil" no Facebook, alguns jornalistas não conseguiram avançar nas buscas, enquanto outros receberam uma mensagem de aviso perguntando se tinham certeza de que desejavam continuar, alertados para a associação do termo com nudez ou atividade sexual, que não é permitida na plataforma.

Já a busca pelo mesmo termo associada ao ICQ foi possível imediatamente.

ICQ de volta das cinzas

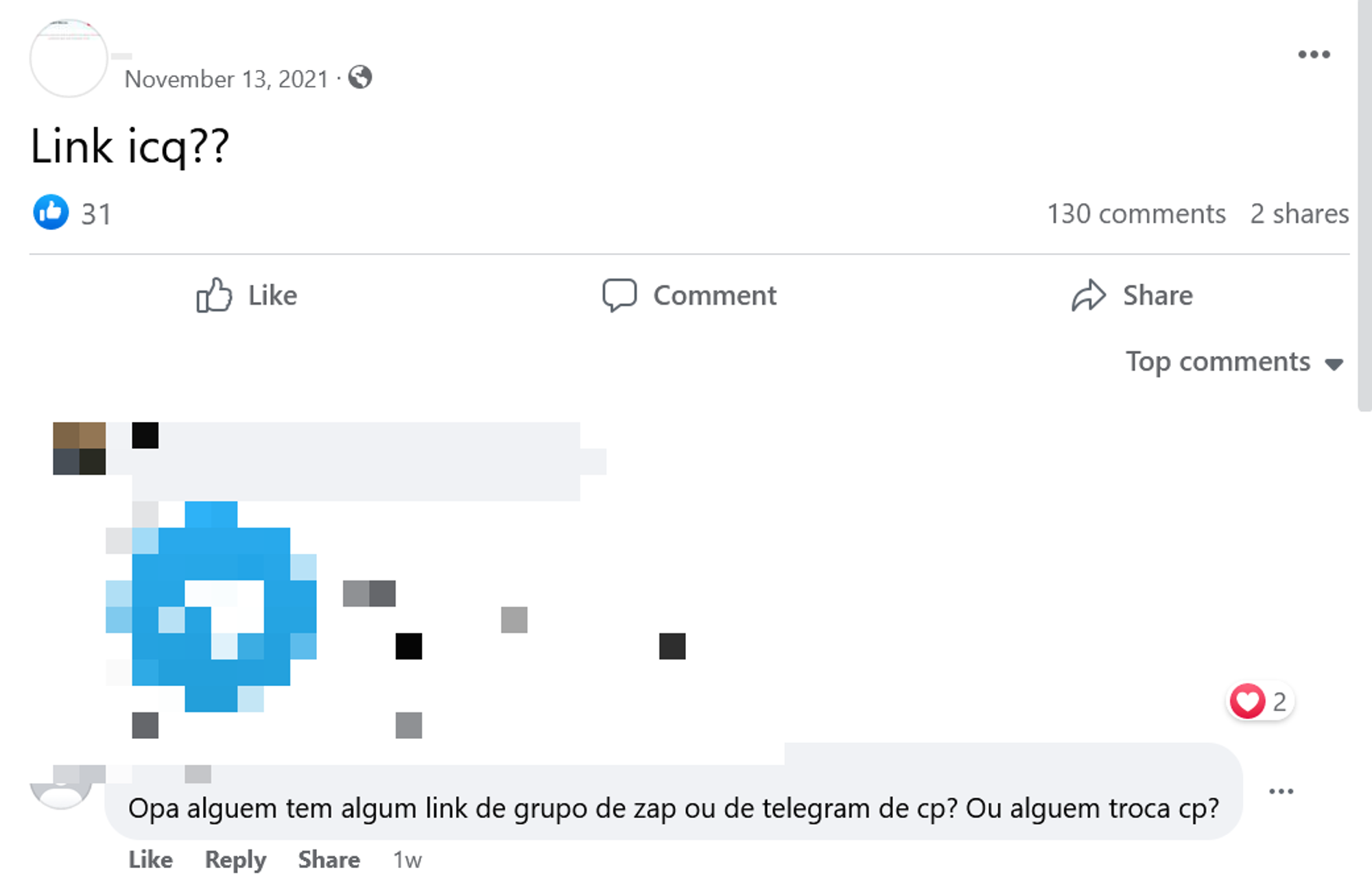

Para além das páginas com postagens de exploração sexual, o Núcleo também identificou no Facebook o compartilhamento constante de links diretos para conteúdo de pornografia infantil – ou seja, as imagens não estavam publicadas diretamente na rede social, mas sim os caminhos que levavam a elas.

E esse links apontam para um lugar: o ICQ.

Durante a pandemia, o ICQ registrou um ressurgimento significativo, com um aumento expressivo no número de usuários, alcançando em 2021 seu maior pico de buscas no Google Trends em uma década.

Estima-se que, em 2022, o ICQ tenha atingido aproximadamente 11 milhões de usuários mensais em todo o mundo. Em 2010, o ICQ foi adquirido pela VK, uma empresa russa anteriormente conhecida como Mail.ru. Nenhuma das empresas possui sede ou representação no Brasil.

Embora a ferramenta de chat tenha perdido popularidade desde seu lançamento em 1996 e pico do começo dos anos 2000, grupos criminosos mantêm uma base de membros ativa, com alguns canais chegando a compartilhar mais de trezentas mensagens por hora.

Obviamente, nem todo conteúdo nessa plataforma está relacionado a pornografia infantil, mas a falta de moderação na plataforma permitiu que esse tipo de crime se proliferasse sem muita resistência.

Diariamente, são compartilhadas centenas de imagens e vídeos de abuso sexual envolvendo menores de idade, com um foco aparentemente maior em meninas com idades entre 3 e 13 anos.

Por vezes, as imagens parecem ter sido capturadas pelos próprios menores de idade, o que levanta preocupações acerca de possíveis situações de aliciamento por meio das redes sociais.

Fácil de achar

A identificação desses links por meio do Facebook foi uma tarefa simples.

Ao pesquisar por termos frequentemente associados a esse crime no mecanismo de busca da rede social, nos deparamos com publicações em grupos abertos (ou seja, que qualquer um pode ver) que divulgam links para canais que abrangem diversos temas e levam a várias plataformas.

Embora seja necessário ressaltar que boa parte das postagens nessas páginas do Facebook não está relacionada a conteúdo criminoso, aquelas que estão, assim como os comentários relacionados, não receberam moderação.

Esses posts levam a comunidades do ICQ, onde a rotatividade e a oscilação no número de usuários são frequentes. Dezenas de usuários entram e saem dos grupos a cada hora, e sempre é possível ver que a maioria dos que entram apagam rapidamente suas contas, uma vez que aparece a mensagem [deleted] entrou no canal.

Entre as comunidades de ICQ monitoradas, a maior tem 7.600 membros, enquanto a média geral de inscritos entre os grupos monitorados até o momento de publicação desta reportagem é de 3.500 pessoas.

O volume de conteúdo, documentos e links criminosos compartilhados por esses usuários é gigante.

O maior grupo, criado em 2021, possui um arquivo com 8.936 imagens, 734 vídeos de pornografia infantil e 5.577 links externos. É comum que esses links externos sejam encurtados e exijam senha ou visualização de anúncios para acesso. Também foram observadas trocas de pornografia infantil por meio de pastas em serviços de armazenamento em nuvem, como MEGA ou Terabox.

A quantidade de imagens aparentemente capturadas por menores de idade é chocante e gera preocupações sobre o aliciamento. O compartilhamento dessas imagens muitas vezes inclui as redes sociais pessoais dos menores de idade, como Instagram e Twitter, o que aumenta o risco de assédio, chantagem e abuso.

Todos os 13 grupos monitorados pelo Núcleo são públicos, não exigindo pagamento ou aprovação interna para ingressar. Isso amplia a preocupação com o impacto da divulgação desses grupos no Facebook, tornando-os mais acessíveis e aumentando seu alcance.

Por exemplo, um dos grupos identificados pelo Núcleo atraiu mais de quinhentos membros após ser divulgado em postagens no Facebook. Ao entrar no canal, foram encontradas imagens explícitas de abuso sexual de crianças.

Embora a postagem original no Facebook seja de 2021, o comentário com o link foi feito em junho de 2023, indicando que usuários estão buscando acesso a esse tipo de conteúdo a partir de posts antigos, como uma forma de despistar moderação.

Conteúdo "vale-tudo"

Outra prática observada pelo Núcleo nesses canais é a propaganda para que os usuários dos grupos entrem em servidores do Discord dedicados à comercialização de conteúdo adulto que dizem vender imagens e vídeos de cunhos sexual vazados de celebridades sem consentimento prévio.

Nas políticas de conteúdo, a plataforma diz permitir a criação de servidores com conteúdo para maiores de 18 anos, desde que seja sinalizado como tal.

Desde 2018, o compartilhamento não autorizado de imagens íntimas configura crime no Brasil. Duas leis, a Lei Rose Leonel (13.772/18) e a Lei 13.718/18, modificaram o Código Penal para punir a divulgação de cenas de nudez, atos sexuais ou estupro sem consentimento. A pena varia de seis meses a um ano de reclusão.

A venda de conteúdo onde "vale tudo" também circula livremente nos grupos do ICQ. Vendedores brasileiros promovem o comércio desse conteúdo criminoso como um um "serviço personalizado" e encontram espaço e destaque nesses canais.

Capturas de tela compartilhadas nas conversas e analisadas pelo Núcleo mostram que para ter acesso, você apenas precisa contatar pessoalmente o vendedor, quais as transações são mediadas por pagamentos via PIX ou PayPal, com valores acessíveis normalmente variando entre R$10 e R$80.

RESPOSTA DO FACEBOOK

A Meta não respondeu diretamente a nenhuma das oito específicas enviadas pelo Núcleo à assessoria da empresa.

Um porta-voz da Meta, no entanto, enviou esse posicionamento genérico: Conteúdos que exploram ou colocam crianças em risco não são permitidos no Facebook. Trabalhamos de forma proativa para encontrar e remover esse tipo de material e encorajamos as pessoas a denunciá-los. Temos políticas, tecnologias e equipes especializadas focadas em eliminar interações abusivas.

Perguntas que enviamos para a Meta

- Sabe-se que Meta automatiza bastante sua moderação. No entanto, uma equipe de pesquisadores de Stanford com apenas três pessoas encontrou uma grande rede de pedofilia no Instagram. Em 2022, o Núcleo descobriu grupos com milhares de pessoas que compartilhavam material de exploração sexual infantil. Quais são as limitações da automação de moderação e por que a Meta não consegue atingir 100% de eficiência para coibir conteúdo de pedofilia?

Sem resposta - O grupo de Links Proibidos tinha 22 mil e está fora do ar agora. Isso tem a ver com o email anterior que mandamos, que continha um print mostrando esse grupo?

Sem resposta - A Meta possui moderadores de conteúdo em língua portuguesa (pessoas mesmo, não programas de computador) especificamente treinados para identificar e combater conteúdo exploratório envolvendo crianças?

Sem resposta - Quais medidas a Meta está planejando adotar para melhorar a detecção da proliferação contínua de conteúdo de exploração sexual envolvendo crianças em suas plataformas?

Sem resposta - As demissões recentes da Meta incluíram cortes em áreas de moderação na área de segurança?

Sem resposta - Quais são as ações concretas adotadas para combater ativamente a proliferação de conteúdo de exploração sexual envolvendo crianças em suas plataformas.

Sem resposta - Estatisticamente, qual a eficácia dessas ações (certamente não é 100%)?

Sem resposta - Qual o número de casos de exploração sexual infantil identificados e removidos nos últimos 48 meses (ano a ano)?

Sem resposta

Necessidade de moderação

A secretária de Direitos Digitais do Ministério da Justiça e dos Direitos Humanos, Estela Aranha, ressaltou em entrevista ao Núcleo a necessidade de moderação das plataformas.

"Não é papel do Ministério da Justiça ser fiscal da internet, e não queremos que seja. Por isso, defendemos a regulação, porque é necessário saber o que e como se pode olhar", disse ela.

Aranha comentou também que, muitas vezes, os bloqueios judiciais nem sempre são totalmente efetivos, uma vez que os serviços ainda podem ser acessados por meio de VPNs, como ocorreu com o Telegram durante as eleições nacionais de 2022, ou após o 8.janeiro.2023.

Questionada sobre a colaboração das grandes plataformas, como o Facebook, em derrubar ou monitorar conteúdo, como exploração sexual e abuso de menores de idade, Aranha afirmou que, geralmente, as empresas são solícitas, mas não sabe responder se é o mesmo caso com o ICQ, uma vez que nunca teve contato com uma denúncia de conteúdo criminoso na plataforma até então.

Como fizemos isso

Realizamos uma pesquisa por grupos de pedofilia no próprio Facebook, utilizando termos previamente conhecidos e associados à pornografia infantil.

Optamos por monitorar esses grupos por duas semanas, entre 8 e 22 de junho, analisando os históricos de conversas, além do comportamento dos usuários. E

Em seguida, solicitamos uma entrevista com Estela Aranha, do MJSP, e enviamos um email pedindo comentários ao Facebook. Após a publicação da reportagem, encaminhamos os materiais usados durante a apuração para a Polícia Federal.