Receba nossas newsletters

É de graça. Só tem coisa fina, você vai curtir!

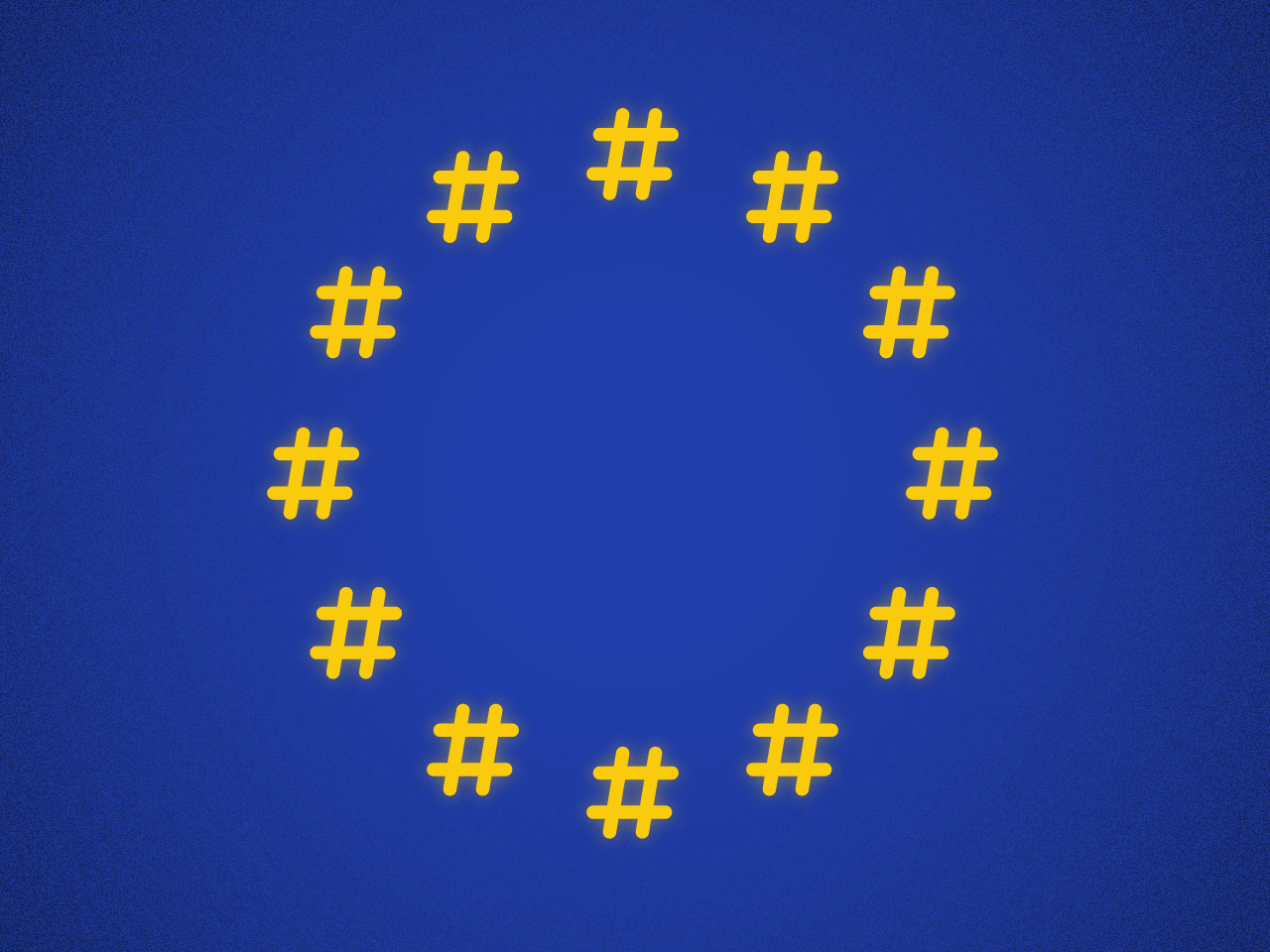

O governo federal foi inspirado em leis europeias de regulação de plataformas para apresentar sugestões ao projeto de lei 2630, conhecido como PL da Fake News. A referência da Europa ainda é recente, mas é vista com bons olhos por muitos especialistas.

As recomendações foram enviadas essa semana ao relator do PL na Câmara, Orlando Silva (PCdoB-SP). As sugestões foram costuradas entre a Secretaria de Comunicação Social da Presidência da República (Secom) e o Ministério da Justiça.

Um dos elementos adotados pela proposta do governo brasileiro foi a introdução, por exemplo, da noção de dever de cuidado, presente no Digital Services Act, legislação em implementação na União Europeia desde nov.2022.

É ✷ importante ✷ porque...

Legislação europeia é considerada uma referência para regulação de redes

Governo não quis inovar muito, preferindo utilizar inspirações que já foram aprovadas e estão em andamento

Deputado que relata PL é da base do governo, e deve acatar muitas sugestões

Dever de cuidado

O "dever de cuidado" estabelece que plataformas de grande porte (com mais de 10 milhões de usuários no Brasil) deverão "atuar de forma diligente e em prazo hábil e suficiente para prevenir ou mitigar práticas ilícitas no âmbito do seu serviço", investindo esforços para melhorar o combate a conteúdos ilegais gerados por terceiros que configurem ou incitem:

- crimes contra o Estado Democrático de Direito, tipificados em lei

- crimes de terrorismo, tipificados em lei

- crimes contra crianças e adolescentes, tipificados em lei

- crimes de racismo, tipificados em lei

- crimes contra a saúde pública, tipificados em lei

- indução, instigação ou auxílio a suicídio ou automutilação, tipificados em lei

- violência de gênero

Uma entidade autônoma de supervisão – esta, também, proposta pelo governo – será a responsável por avaliar o cumprimento ou não do dever de cuidado, levando em conta a atuação da plataforma e a avaliação de relatórios periódicos.

O governo propõe, no art. 13, que plataformas de grande porte poderão ser responsabilizadas civilmente por danos decorrentes de conteúdo gerado por terceiros "que constituam práticas ou incitação à prática dos crimes" descritos acima, "quando demonstrado conhecimento prévio e comprovado o descumprimento do dever de cuidado".

NOTIFICAÇÃO E REMOÇÃO

Pelo texto, para configurar "conhecimento prévio" bastaria a empresa ter recebido denúncias de usuários que detalhem claramente a violação daquele conteúdo. Esse formato é semelhante ao notice and takedown adotado no NetzDG, a lei alemã de regulação de plataformas.

Esse novo regime proposto pelo governo, no entanto, conflita com o que diz o art. 19 do Marco Civil da Internet, que hoje estabelece que plataformas só podem ser responsabilizadas por conteúdo de terceiros caso descumpram ordem judicial sobre aquele conteúdo.

AVALIAÇÃO DE RISCOS

A inspiração europeia também aparece na noção de avaliação sistêmica de riscos, que transfere para plataformas a obrigação de conduzir análises diligentes sobre riscos "decorrentes da concepção ou funcionamento de seus serviços e sistemas".

Essa avaliação, pela proposta do governo, deverá ser anual e deve acontecer antes da introdução de funcionalidades que podem ter um impacto crítico aos seguintes riscos identificados pela lei:

- exercício de direitos fundamentais;

- garantia e promoção da liberdade de expressão, informação e imprensa;

- processos políticos-institucionais e eleitorais.

CAIU IMUNIDADE PARLAMENTAR

Um dos pontos mais indigestos da versão atual do texto na Câmara dos Deputados foi removido pelo governo.

Tratava-se de um artigo que garantia imunidade parlamentar, poupando políticos eleitos que difundissem fake news ou conteúdo nocivo de punições por parte das plataformas.

No lugar desse artigo, o governo introduziu um que estabelece que plataformas só podem bloquear ou excluir contas de cidadãos eleitos se houver decisão judicial ou limitando-se a uma suspensão de, no máximo, 7 dias para casos de "violação contumaz" dos termos e políticas de uso ou disseminadores de discurso de ódio, conteúdos ilícitos ou com "potencial de provocar dano iminente de difícil reparação".

ENTIDADE AUTÔNOMA

O texto prevê também a criação de uma entidade autônoma com atribuição de fiscalizar o cumprimento das regras pelas plataformas, instaurar processos administrativos e, quando constatado descumprimento, aplicar sanções.

O órgão definirá, em regulamentação própria, os procedimentos de apuração e os critérios de aplicação de sanções administrativas para quem quebrar a lei.

Plataformas de grande porte pagarão uma taxa anual de supervisão proporcional ao número médio mensal de usuários ativos e à sua receita. Essa taxa será destinada ao orçamento da entidade.

O governo não deixou claro, no entanto, como seria formada e quem comporia essa entidade autônoma. No art. 49, diz apenas que a entidade "deverá contar com garantias de autonomia administrativa e independência no processo de tomada de decisões e deve contar com espaços formais de participação multissetorial".

CARGOS PÚBLICOS

O texto traz outros artigos regulando a atuação de políticos eleitos e ocupantes de cargos públicos nas plataformas, por exemplo proibindo a monetização de contas de eleitos, magistrados, membros das Forças Armadas, do Ministério Público e militares dos Estados.

O governo propõe que contas institucionais não podem impedir outros usuários de verem seu conteúdo – como os bloqueios feitos pela gestão de Jair Bolsonaro – e que contas públicas devem fornecer em Portal da Transparência dados sobre a contratação de publicidade ou impulsionamento.

A proposta também sugere proibir que o Poder Público destine recursos a publicidade em sites ou meios que promovam discursos destinados ao cometimento e incitação de crimes previstos no art. 12 da lei.

MAIS TRANSPARÊNCIA

O texto do governo prevê que plataformas terão a obrigação da transparência ativa, passando a:

- fornecer informações sobre o funcionamento das redes

- assegurar direito ao devido processo

- fornecer explicação sobre decisões automatizadas

- publicar relatórios próprios e de auditores independentes

- abrir dados para pesquisa acadêmica e relatórios sobre riscos sistêmicos

Os relatórios de transparência serão publicados semestralmente contendo dados agregados sobre Brasil e disponibilizados em fonte aberta em língua portuguesa. Eles deverão trazer informações sobre tempo de moderação dedicado ao país e mudanças são sistema de recomendação.

Usuários também deverão ser notificados de decisões de moderação, que devem ser especificamente sinalizadas quando tomadas de maneira automatizadas.

CÓDIGO DE CONDUTA

O governo propõe que o Congresso Nacional elabore, em até 45 dias após a sanção da lei, um Código de Conduta de Enfrentamento à Desinformação contendo medidas para:

- frear a disseminação de mentiras;

- ter medidas para garantir a desmonetização;

- criar regras para impedir publicidade com desinformação, entre outros pontos.

Esse código será elaborado por uma comissão temporária que deverá ser composta por representantes das empresas, membros da Câmara dos Deputados e do Senado Federal, membros da comunidade acadêmica, representantes da sociedade civil e representantes de entidades de jornalismo e checagem.

Reportagem Laís Martins

Arte Rodolfo Almeida

Edição Sérgio Spagnuolo

Texto atualizado às 11h42 de 3.abr.2023 para corrigir o nome do deputado Orlando Silva. Uma versão anterior erroneamente estava como Orlando Brito.