Receba nossas newsletters

É de graça. Só tem coisa fina, você vai curtir!

Entre um vídeo de dancinha e um de meme, duas redes sociais amplamente utilizadas por crianças e adolescentes, TikTok e Kwai, se tornaram espaços usados para promover links de grupos com conteúdos de abuso sexual infantil, mostra uma nova investigação do Núcleo.

No TikTok, não foram encontrados vídeos explícitos com sexualização de menores de idade, mas grupos de usuários usam a plataforma para disseminar livremente links que promovem trocas de conteúdo ilegal e criminoso.

Já o Kwai está inundado com milhares de comentários de vídeos sexualizando menores de idade, mesmo em vídeos de perfis familiares controlados pelos pais para retratar o cotidiano de crianças influencers.

Estima-se que, juntos, o Kwai e o TikTok tenham mais de 130 milhões de usuários no Brasil. Utilizados majoritariamente por jovens, os apps têm, segundo as próprias empresas, tecnologias específicas para deixar seu público e a plataforma seguras de abusos.

É ✷ importante ✷ porque...

Encontramos vídeos hospedados no TikTok que levam a grupos e arquivos online de pornografia infantil

Usuários do Kwai já recorreram a meios alternativos como ReclameAqui para falar sobre o problema, empresa não ouviu

Os mecanismos de busca das plataformas sugerem que usuários procurem por conteúdo de exploração sexual sobre menores de idade

A presença constante desse conteúdo indica dificuldade das plataformas de se atualizarem para conter referências internas e externas de assédio infantil.

Em nota ao Núcleo, o Kwai admite isso: "algumas pessoas tentam burlar essas restrições inserindo frases de duplo sentido ou substituindo letras por números, por exemplo", acrescentando que "está comprometido em permanecer um passo à frente dessas práticas."

O TikTok foi mais vago, dizendo que "tem tolerância zero para conteúdo de abuso sexual infantil" e que remove vídeos do tipo assim que toma conhecimento. Mas a rede chinesa não explica por que, mesmo com todo esse rigor, a plataforma não consegue moderar referências conhecidas sobre conteúdo de exploração infantil.

Algumas das buscas feitas pelo Núcleo, inclusive, possuem termos que são utilizados há anos por criminosos, mas que ainda assim não são moderados.

Não há como saber com certeza quantos perfis são administrados por menores de idade, já que a idade mínima para criar uma conta no Kwai é de 12 anos, enquanto no TikTok é de 13 anos. Nenhuma das empresas divulga essas informações.

O Núcleo tem reportado sobre essa situação desde 2022, quando identificou páginas de exploração sexual no Facebook. Mais recentemente, investigamos a propagação de links com pornografia infantil para o ICQ através dos buscadores de Google e Bing, além de posts e comentários no Facebook.

SAIBA MAIS — Impacto do Núcleo nas denúncias de abuso sexual de menores de idade nas redes

O Núcleo tem reportado sobre essa situação desde 2022, quando identificamos páginas de exploração sexual no Facebook. Vale notar que não foram encontradas imagens explícitas de pornografia infantil, mas fica claro pelo contexto que se tratam de conteúdos com conotação sexual envolvendo crianças.

Em 2023, o Núcleo identificou, monitorou e denunciou mais de 8 grupos de pornografia infantil hospedados no ICQ. Links para esses canais estavam sendo indexados no Google e Bing. Eles também foram encontrados em comentários e páginas no Facebook. Após nossa reportagem, o Google removeu o ICQ da Play Store.

“ADOLESCENTE FAZENDO AQUILO”

Em seus termos de uso, o Kwai proíbe explicitamente a veiculação de conteúdo ou comportamento que explorem menores, bem como material pornográfico e qualquer conteúdo que contenha atos sexuais ou linguagem obscena.

Desde fev.22, surgiram ao menos 9 denúncias sobre conteúdos supostamente “pedófilos” na rede social no site ReclameAqui, dedicado a expor problemas não resolvidos pelos canais de atendimento das empresas. Pessoas que registraram essas queixas também disseram terem sido banidas de suas contas após reclamarem sobre conteúdo e perfis sexualizando menores de idade.

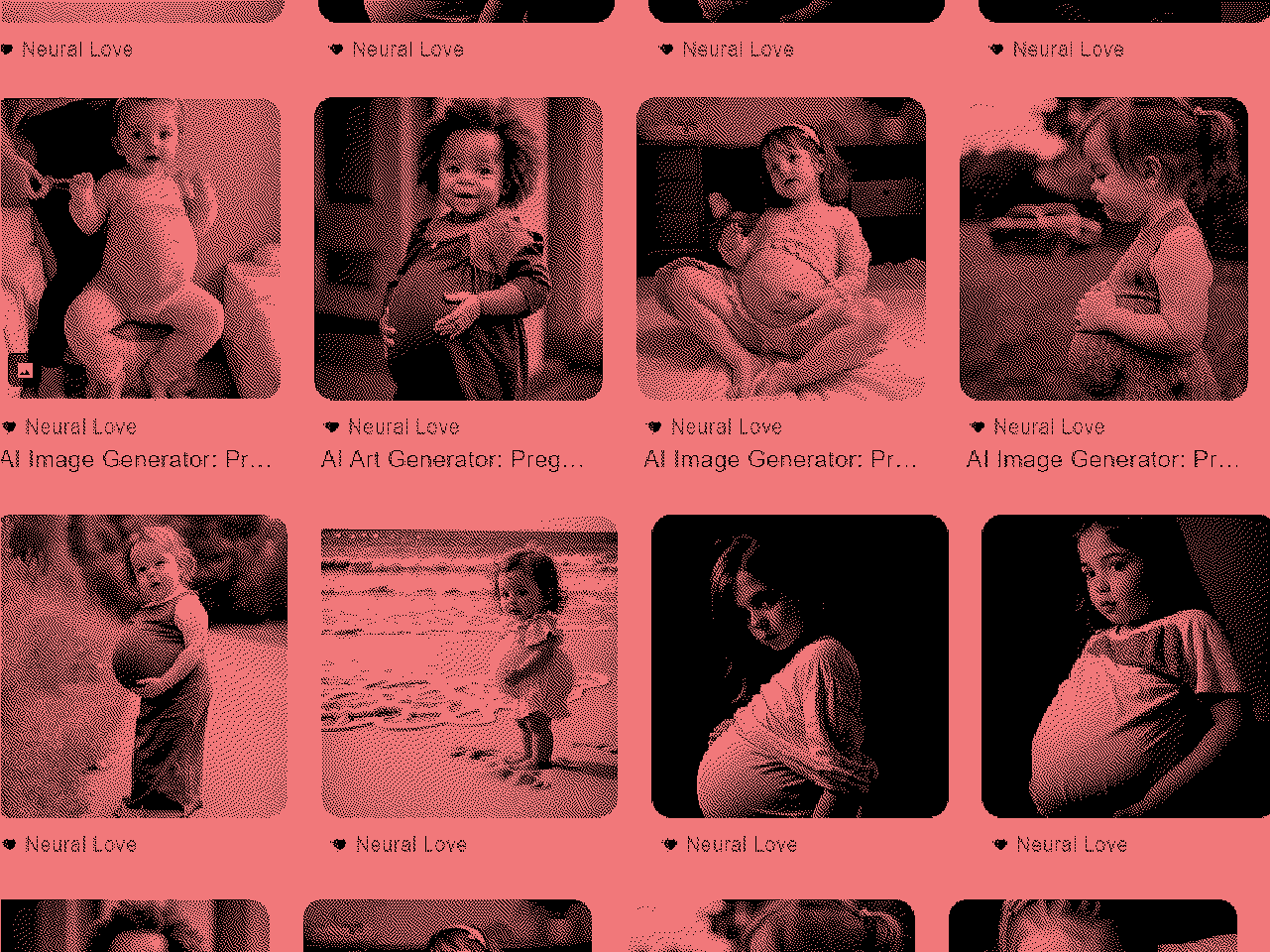

Não é necessário saber os termos internos usados em grupos online de exploração sexual de menores de idade para encontrar conteúdo impróprio no Kwai. O próprio mecanismo de busca da rede pode levar até essas publicações.

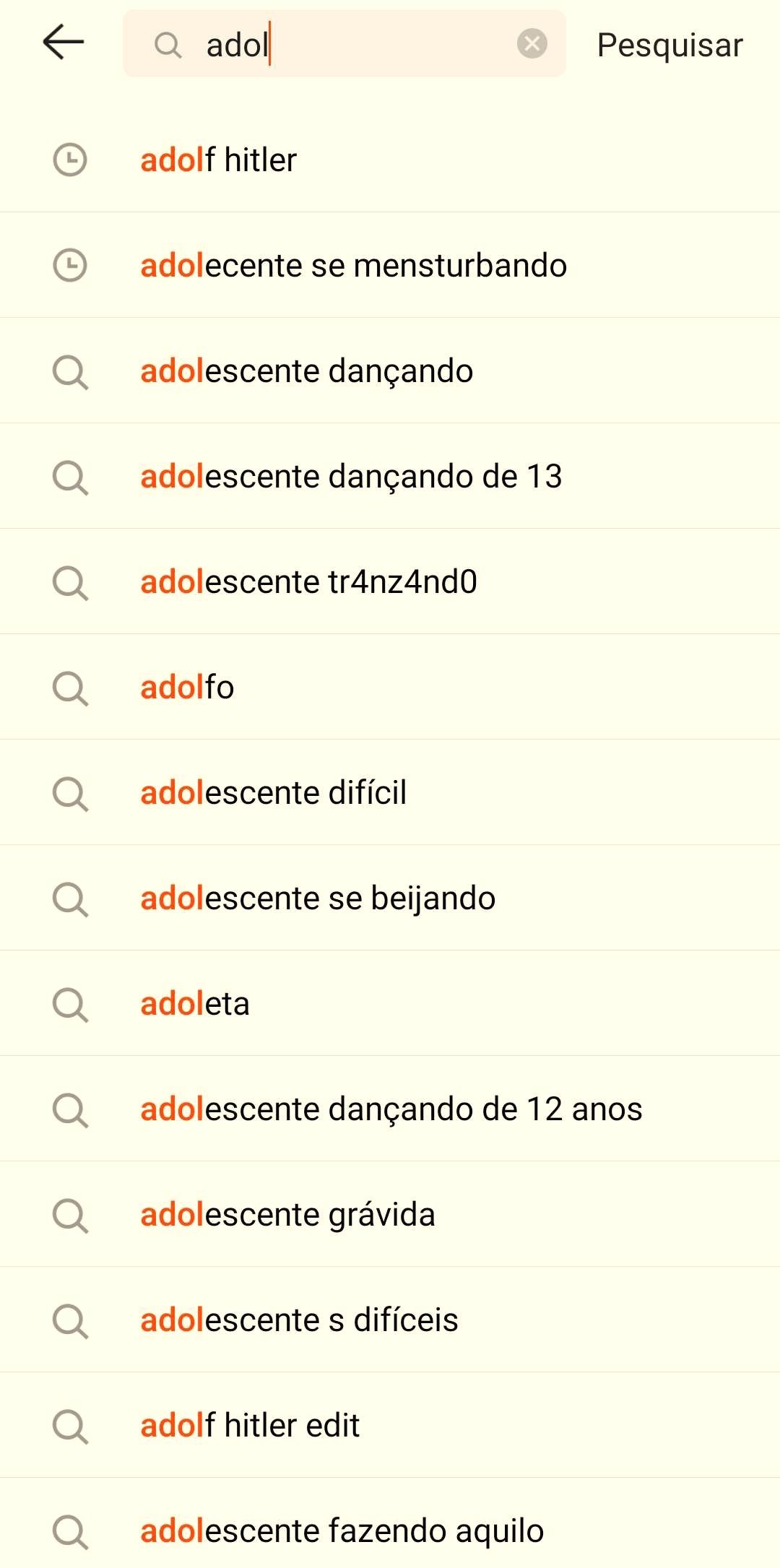

Por exemplo, ao começar a escrever a palavra “adolescente” no buscador do Kwai, recebemos sugestões de conteúdo como “adolescente fazendo aquilo”, “adolescente dançando de bikíni” e outros de conotação sexualmente imprópria.

O Núcleo também usou as terminologias usadas por pesquisadores americanos da Universidade de Stanford, nos Estados Unidos, para identificar uma rede de pedofilia no Instagram, em junho.

Ao fazer isso, nos deparamos com diversos perfis que publicavam diariamente vídeos de pré-adolescentes com conotações sexuais nas legendas ou comentários.

Um desses perfis analisado pelo Núcleo possui 14 mil seguidores e recebeu 140,6 mil curtidas em suas publicações. Os vídeos no feed são divididos entre mulheres jovens, que podem se passar por adultas apesar de não terem sua idade explicitada, e outras que são claramente meninas menores de idade.

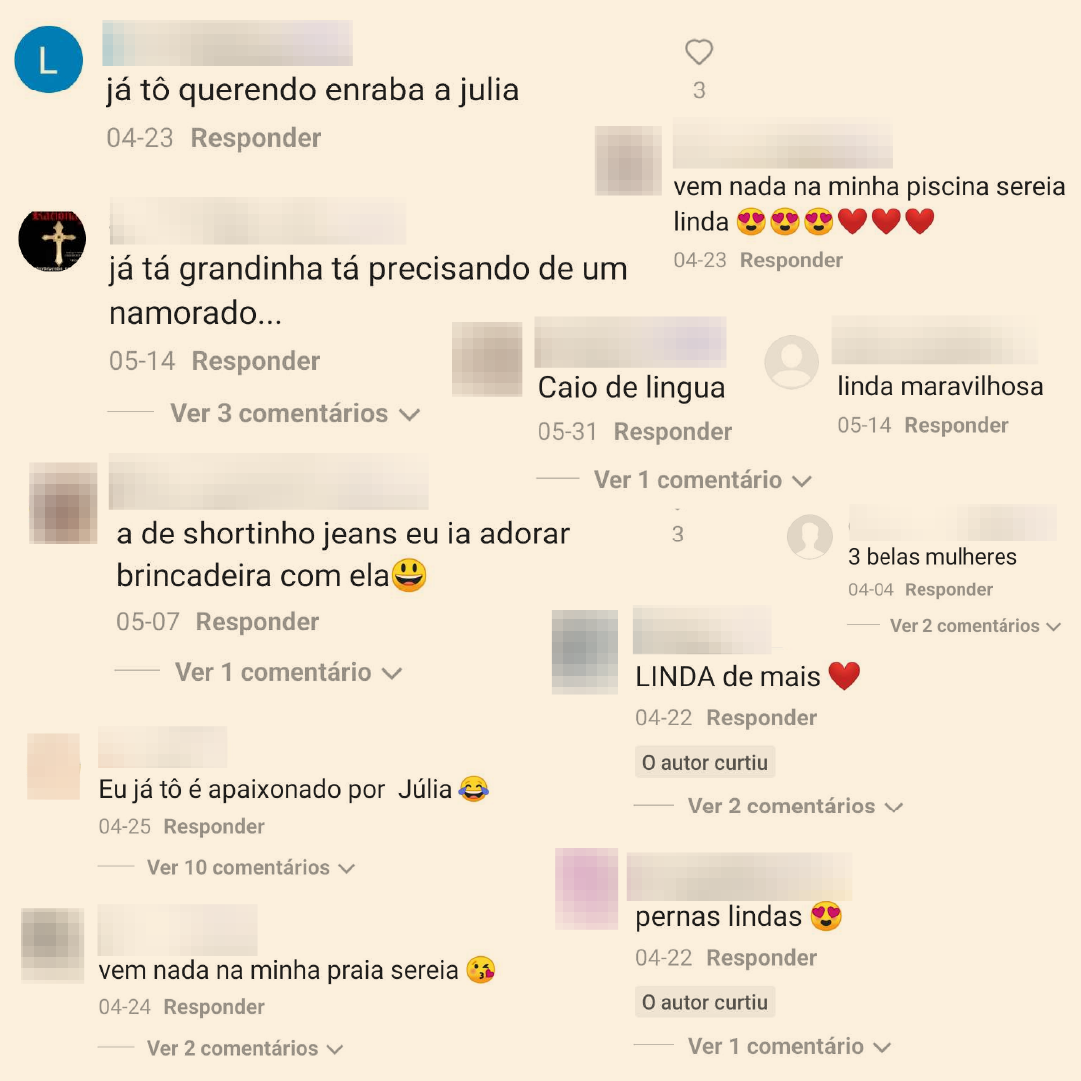

Alguns dos posts mais recentes na conta mostram pré-adolescentes dançando em trajes de banho na praia, e aparentam terem sido republicados dos perfis das próprias crianças pelo perfil de exploração sexual. Nos comentários, predominam emojis de coração ou figurinhas com dizeres como “tô babando”.

Ainda há o problema de perfis que se autodenominam familiares, semelhantes aos canais de família no YouTube, e que produzem vídeos sugestivos envolvendo seus próprios filhos.

Nesses casos, uma vez que o menor de idade não administra a conta, é complicado saber qual é o papel da plataforma na moderação desses vídeos. Mas há algo certo: os comentários são de responsabilidade do Kwai, e eles não parecem estar sendo fiscalizados adequadamente.

Em um perfil desse estilo, onde a mãe registra o cotidiano da filha, um breve vídeo da criança na piscina gerou uma variedade de comentários, desde críticas à mãe, acusando-a de expor ou sexualizar intencionalmente a própria filha, até comentários exploratórios, como “realmente tá molhanda [sic] e bem fresquinha”, “morena linda princesa” e “da série mães cafetinas que querem exibir crianças em troca de likes”.

TERMOS OBSCUROS

Também foram identificados inúmeros perfis dedicados à postagem de vídeos que facilitam encontrar canais onde se acha e troca-se conteúdo sexual exploratório envolvendo crianças. Isso é feito no TikTok, plataforma da ByteDance, através de táticas simples comumente usadas por quem troca pornografia infantil.

Para evadir moderação, usuários se utilizam de estratégias conhecidas de abusadores, que é modificar a sigla para pornografia infantil em inglês (CP) para outros termos com as mesmas iniciais.

No TikTok, o Núcleo rastreou que muitos usuários de países hispânicos estão usando o termo derivado para não serem detectados. Após consulta com especialista, optamos por não divulgar qual é esse termo a fim de não facilitar sua descoberta por pessoas má intencionadas.

O objetivo é criar vídeos pouco chamativos, mas que sirvam de espaço de conversa para interessados e pedirem links para grupos no Telegram, Discord, Signal e outros espaços fora da plataforma. Links inválidos são comuns, o que faz os usuários terem que ficar atentos a novos conteúdos com as hashtags usadas por quem propaga esses conteúdos.

Há anos essa tática — utilizada em outras plataformas — já foi exposta por tiktokers e pela própria imprensa latino-americana. Mesmo assim, parece não ter tido sem muito efeito no regime de moderação do TikTok.

Além disso, o TikTok inclusive sugere pesquisas similares que fazem o trabalho do usuário interessado nesse tipo de conteúdo, facilitando o uso e a disseminação por possíveis abusadores.

Para João Francisco Coelho, advogado do programa Criança e Consumo do Instituto Alana, o quadro apresentado pela reportagem mostra a necessidade de que contextos locais sejam mais observados pelas Big Techs.

“Essas redes criminosas que usam plataformas digitais para disseminar conteúdos criminosos muitas vezes passam a empregar termos e siglas que só quem vai entender são pessoas que conhecem especificamente a realidade brasileira ou da América Latina”.

Coelho também chamou atenção para a diminuição das equipes de moderação nas plataformas. Várias empresas têm demitido profissionais da área nos últimos anos. O Núcleo tem reportado sobre as condições precárias que muitos desses profissionais vivem em seu dia a dia.

RESPOSTA DAS EMPRESAS

Conduzimos três perguntas específicas às assessorias das empresas. Nenhuma delas respondeu diretamente às perguntas do Núcleo ponto a ponto.

Na íntegra — perguntas que fizemos às assessorias

Kwai

- Em nossa reportagem, podemos observar que, ao começar a escrever a palavra “adolescente” no buscador começam a aparecer sugestões de cunho sexual, como “adolescente se mensurando” e outros. Isso aparece nos celulares de ambos os repórteres responsáveis pela matéria. Por que o buscador faz esse tipo de sugestão?

- Qual o tipo de buscador (search engine) usado pelo Kwai e por que ele dá relevância para esse tipo de busca?

- Esse tipo de resultado implica em dizer que os usuários do Kwai estão procurando com frequência esses termos?

TikTok

- Foi fácil observar na mídia latino-americana que grupos de abusadores se utilizam do termo [XXX] em diversos aplicativos e redes sociais para criar grupos que facilitam troca de links para espaços fora da plataforma com conteúdo criminoso. Mesmo assim, o Núcleo achou diversos conteúdos com esse tipo de busca. Por que é tão fácil usar esse tipo de conteúdo no TikTok?

- Qual o tipo de buscador (search engine) usado pelo Tik Tok e por que ele dá relevância a resultados assim?

- Como funciona o “pesquisa similares” no TikTok?

Na íntegra — posicionamento do Kwai

O Kwai tem um algoritmo que leva em consideração o que os usuários procuram e sugere conteúdos que estejam de acordo com suas preferências. A ferramenta de buscas passa constantemente por verificações de segurança para evitar conteúdos que possam violar as Diretrizes da Comunidade, incluindo o uso de termos específicos e ofensivos e suas diferentes variações de escrita.

Algumas pessoas tentam burlar essas restrições inserindo frases de duplo sentido ou substituindo letras por números, por exemplo. No entanto, o Kwai está comprometido em permanecer um passo à frente dessas práticas.

Também é importante destacar que a plataforma possui mecanismos de segurança que atuam 24 horas por dia, combinando inteligência artificial e análise humana para identificar e remover o mais rápido possível conteúdos que violem ou infrinjam as Diretrizes da Comunidade e Termos de Serviço assim que identificados. A segurança dos usuários é prioridade para o Kwai, que constantemente aprimora as ferramentas para manter um ambiente saudável e seguro para a comunidade.

Na íntegra — posicionamento do TikTok

O TikTok tem tolerância zero para conteúdo de abuso sexual infantil. Quando encontramos qualquer tentativa de publicar, obter ou distribuir CSAM (Material de Abuso Sexual Infantil), removemos o conteúdo, banimos contas e dispositivos, informamos imediatamente o NCMEC (Centro Nacional para Crianças Desaparecidas e Exploradas) e colaboramos com as autoridades policiais, conforme necessário.

COMO FIZEMOS ISSO

Procuramos por termos relacionados à pornografia infantil no Kwai e no TikTok. Identificamos comentários assediadores no Kwai e a coordenação de distribuição de links para outros aplicativos no TikTok. Registramos essas ocorrências e entramos em contato com as assessorias das empresas.